信托今天人人翘首瞻仰的都是统一个主角,Meta藏到现在的王牌、最被社区看好能直接叫板GPT-4o的新一代开源大模子—Llama 3.1系列,终于正式宣布了。

鉴于4月公然的两个Llama 3小参数模子8B和70B显示不俗,令开发者们对*参数版本的强悍性能充满期待。

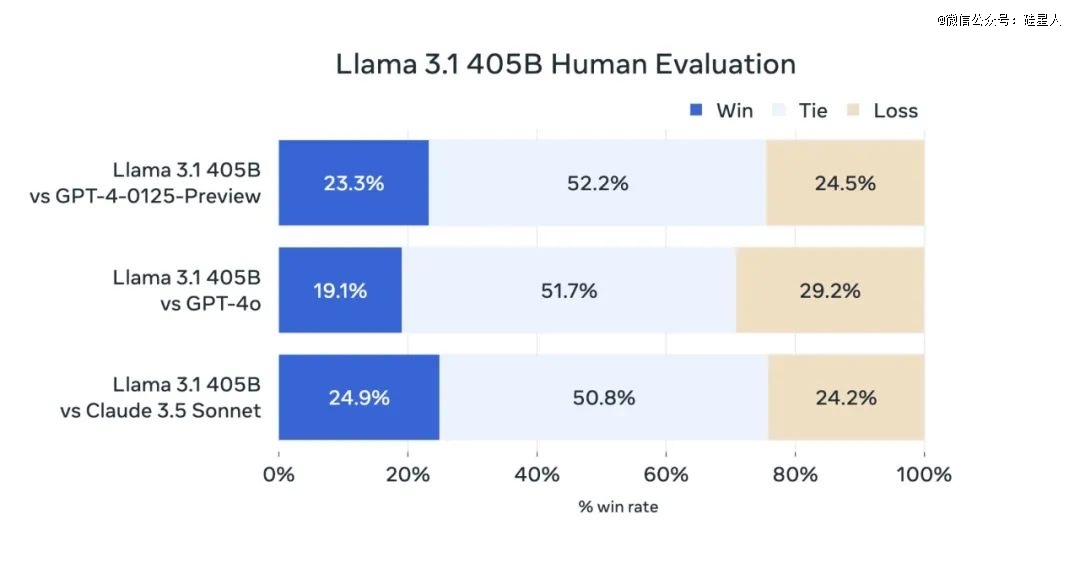

昨天破晓,部门“要害情报“更是在Reddit和Hugging Face上遭到泄露,爆料者称它已匹敌GPT-4o和Claude 3.5 Sonnet。今天看来这所言非虚:

开源大模子首次击败了闭源最强SOTA模子。

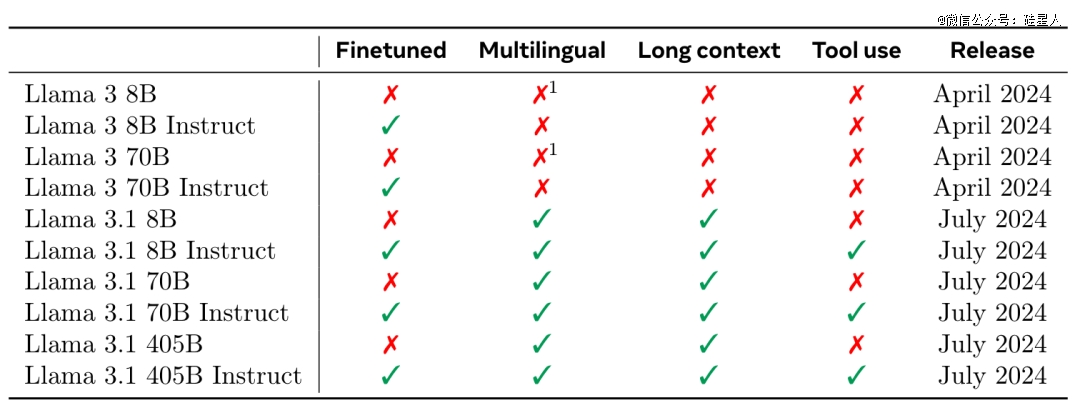

此次Llama 3.1共宣布8B、70B 和 405B三个尺寸。能力周全提升,原生支持8种语言,最长上下文窗口128k。

其中超大杯 405B 包罗 4050 亿个参数,是*“前沿级别开源AI模子”,也是近年来规模*LLM之一。

在通用知识、可指导性、数学、工具使用和多语言翻译等普遍义务中足以对标GPT-4、Claude 3.5 Sonnet等*闭源模子。

Llama 3.1 8B和70B也在老版本基础上举行了推理能力和平安性升级,除多语言和上下文扩展外,还支持更多诸如长文本总结、多语言对话署理和编程助手等高级用例。

#01

全系列主要亮点包罗:

模子架构:延续Llama 3的尺度解码器 transformer 架构,以*化训练稳固性。

巨量数据:405B在15万亿token(相当于7500亿个单词)上训练,连系2500万合成数据微调。包罗了更多的非英语资料、 “数学数据”和代码、以及最近的网络数据。

指令微调:后训练中每一轮都使用监视微协调直接偏好优化来迭代,并通过多轮对齐来改善模子的指令追随能力和平安性,天生最终的谈天模子。

GPU规模:使用跨越 1.6 万个 H100 GPU,训练时长高达惊人的3930万GPU小时。

预训练知识库:更新至2023年12月。

多语言支持:涵盖英语、法语、德语、印地语、意大利语、葡萄牙语、西班牙语和泰语共8种语言。

此外,与Anthropic和OpenAI的竞争模子一样,所有Llama 3.1模子都可以使用第三方工具、应用程序和API来完成义务。支持零样本条件下的工具挪用和操作,显著提升义务处置的天真性和效率。

Meta AI团队在同步揭晓的《The Llama 3 Herd of Models》论文里对比了Llama 3框架下所有模子现在的能力。(共92页,下载地址:

另有一个分外福利:为了激励合成数据的使用,Meta更新了更宽松的允许证,允许开发者使用Llama 3.1模子的高质量输出来改善和开发第三方AI天生模子。

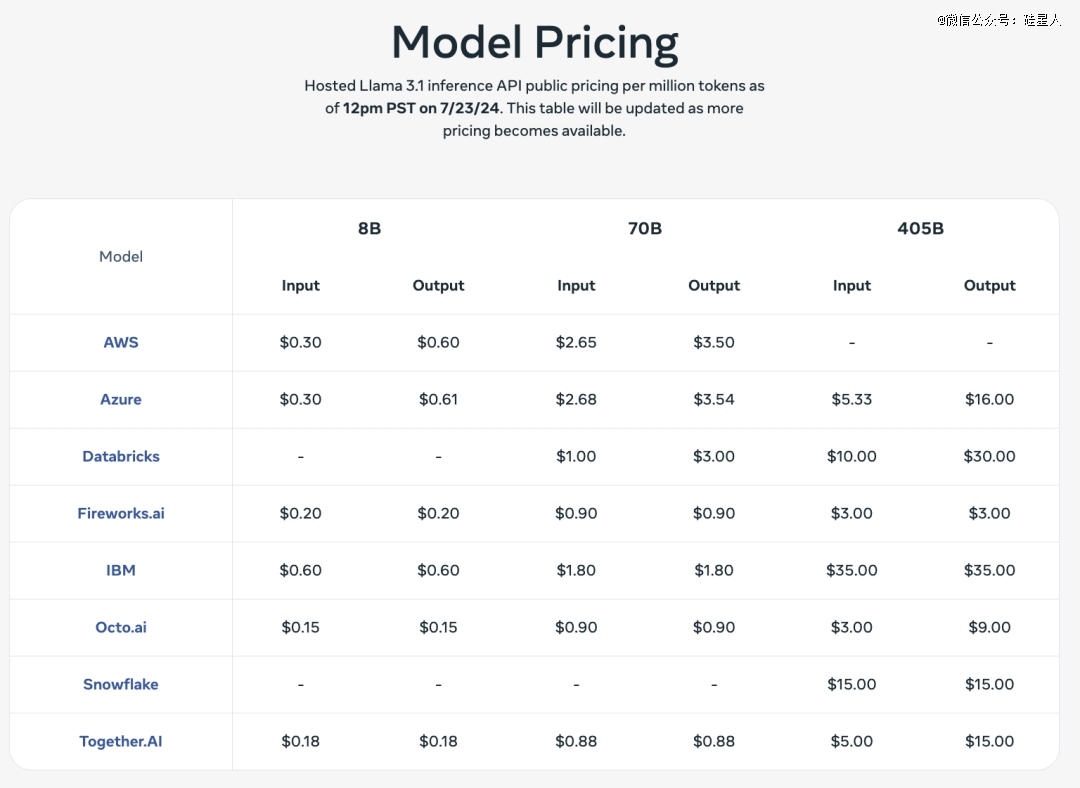

在各API服务平台的订价如下。扎克伯格示意,Llama 3.1是一套高效且价钱实惠的模子,“开发者可以在他们自己的基础设施上运行405B 的推理,成本约莫是GPT-4o 这种封锁模子的50%,适用于用户界面和离线义务。”

而且Llama模子的权重可以下载,开发者可以凭证自己的需求完全自界说应用,而无需与Meta共享数据。

#02

405B 开源最强、多项打败GPT-4o

8B/70B领跑中小模子

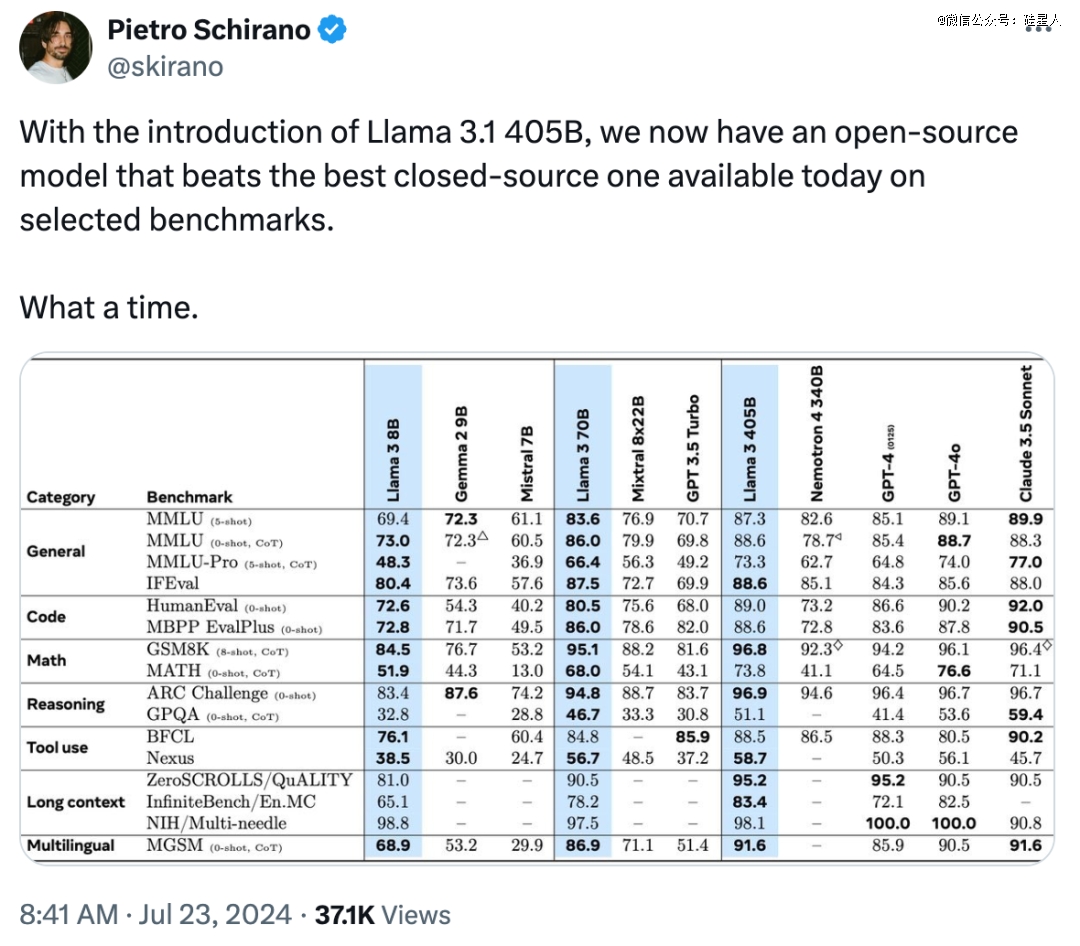

Meta称他们在跨越150个基准数据集上举行了性能评估,涵盖多种语言。并举行了普遍的人类评估,将Llama 3.1与竞争模子拿到现实场景中举行对照。

实验效果解释,Llama 3.1 405B在各项义务中完全可与*进闭源模子竞争,包罗GPT-4、GPT-4o和Claude 3.5 Sonnet。

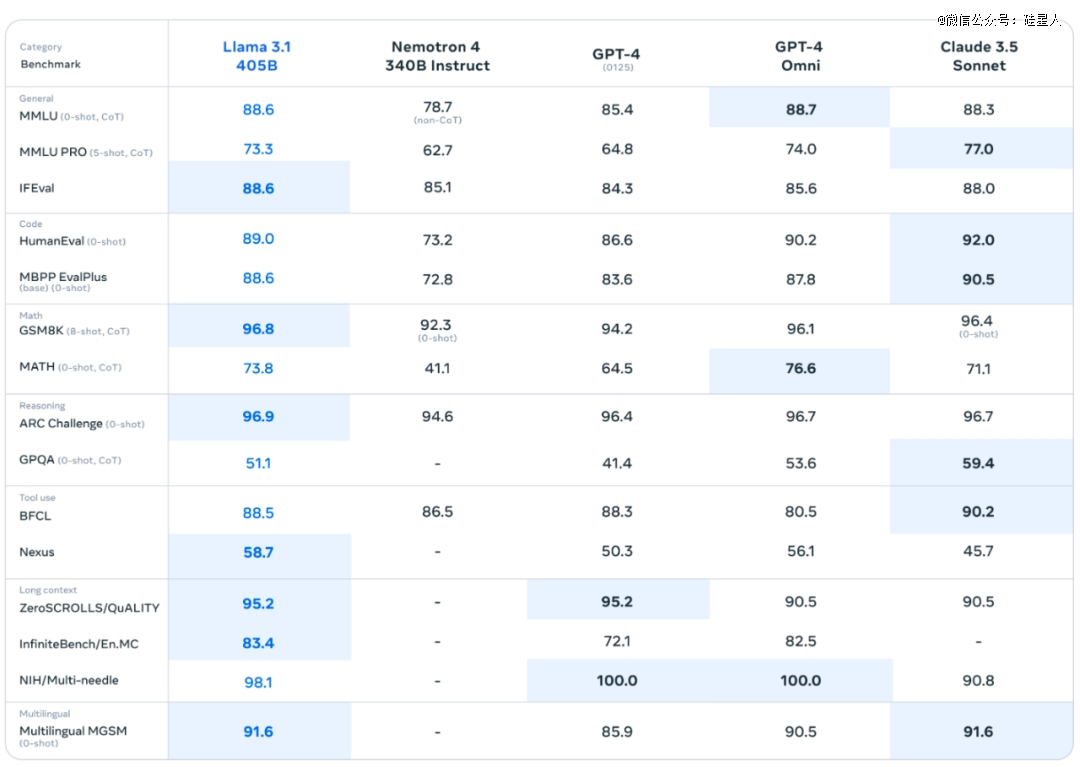

在GSM8K数学、IFEval指令遵照、多语言处置、长上下文、ARC推理、Nexus工具挪用等多项测试上义无反顾,生猛夺冠。此外8B和70B在与同级别小参数模子对战中也显示优异。

详细战绩如下表所示:

通用义务基准上,Llama 3 405B 在多语言评估MGSM和指令遵照测试IFEval中均位列*。MMLU微微落伍GPT-4o 0.1%,优于Claude 3.5 Sonnet。另一方面,Llama 3.1 的70B 和8B 模子在三个义务中均显示精彩,在竞争对手中遥遥*。

宝马「不降价」背后:销售淡季,新能源都在削减优惠

Llama 3.1 405B具有异常突出的数学能力。在GSM8K义务中显示*,得分96.8,高于GPT-4o的96.1和Claude 3.5 Sonnet的96.4。MATH义务成就仅次于GPT-4o。

推理方面,在ARC 挑战义务中,Llama 3.1 405B再次力克两个闭源壮大对手夺冠。GPQA评估上略逊于后两者,但仍优于市面上其它模子。

来到长上下文,Llama 3.1 405B在零样本基准质量ZeroSCROLLS和无限基准小说多选问答InfiniteBench/En.MC上又登榜首。多针检索Multi-needle不敌GPT-4o,但远凌驾Claude 3.5 Sonnet。

最后是代码天生能力。在评估Python天生的HumanEval和其它编程语言的MBPP EvalPlus测试中,8B和70B继续大幅*同级别模子,但大参数模子上显示*的照样Claude 3.5 Sonnet。

从上述要害基准测试效果来看,Llama 3.1 405B的综合实力已与业界最新、最强、最高不能攀的标杆模子GPT-4o们旗鼓相当,甚至实现多项逾越。

不仅成为当前开源领域的*,更是首次将开源与闭源天下SOTA模子之间的差距缩小至零,亲手打破了OpenAI和Anthropic耐久以来的神秘滤镜。

扎克伯格将Llama 3.1誉为“艺术的起点”,并自信地示意:“从明年最先,未来的Llama模子将成为行业内*进的。但即便在那之前,Llama在开放性、可定制性和成本效益方面已然处于*职位。”

#03

开源来势凶猛,大模子名目将变

对于宽大科研职员和手艺开发者们来说,这无疑是一个里程碑式的时刻。

EverArt AI首创人Pietro Schirano叹息道,“随着 Llama 3.1 405B 的推出,我们现在有了一款在部门基准测试上跨越现有*闭源模子的开源选择——真是一个了不起的时代。”

英伟达高级研究科学家Jim Fan说,“GPT-4的气力现在被掌握在了我们手中。一个真正的历史时刻!”

刚宣布AI教育创业的手艺大神Andrej Karpathy在X揭晓长文,欣喜地示意天生式AI领域终于“首次有了一个尖端能力的LLM 可供所有人使用和构建。”而且这个模子开放权重、允许宽松,可商业使用、合成数据天生、蒸馏和微调。

“我喜欢说现在还处于异常早期的阶段,就像我们回到了20 世纪80 年月的盘算机时代,LLMs 是下一个主要的盘算范式,Meta 显然正定位于成为开放生态系统的*。”

Karpathy以为Llama 3.1将引发开源社区的伟大潜力:

开发者将行使RAG手艺优化模子,举行微调,并将其蒸馏成针对特界说务的小型专家模子。研究职员将深入研究、测试和改善模子。整个开放生态系统也将以模块化方式自组织,形成种种产物、应用和服务,让每个介入者都能施展所长。

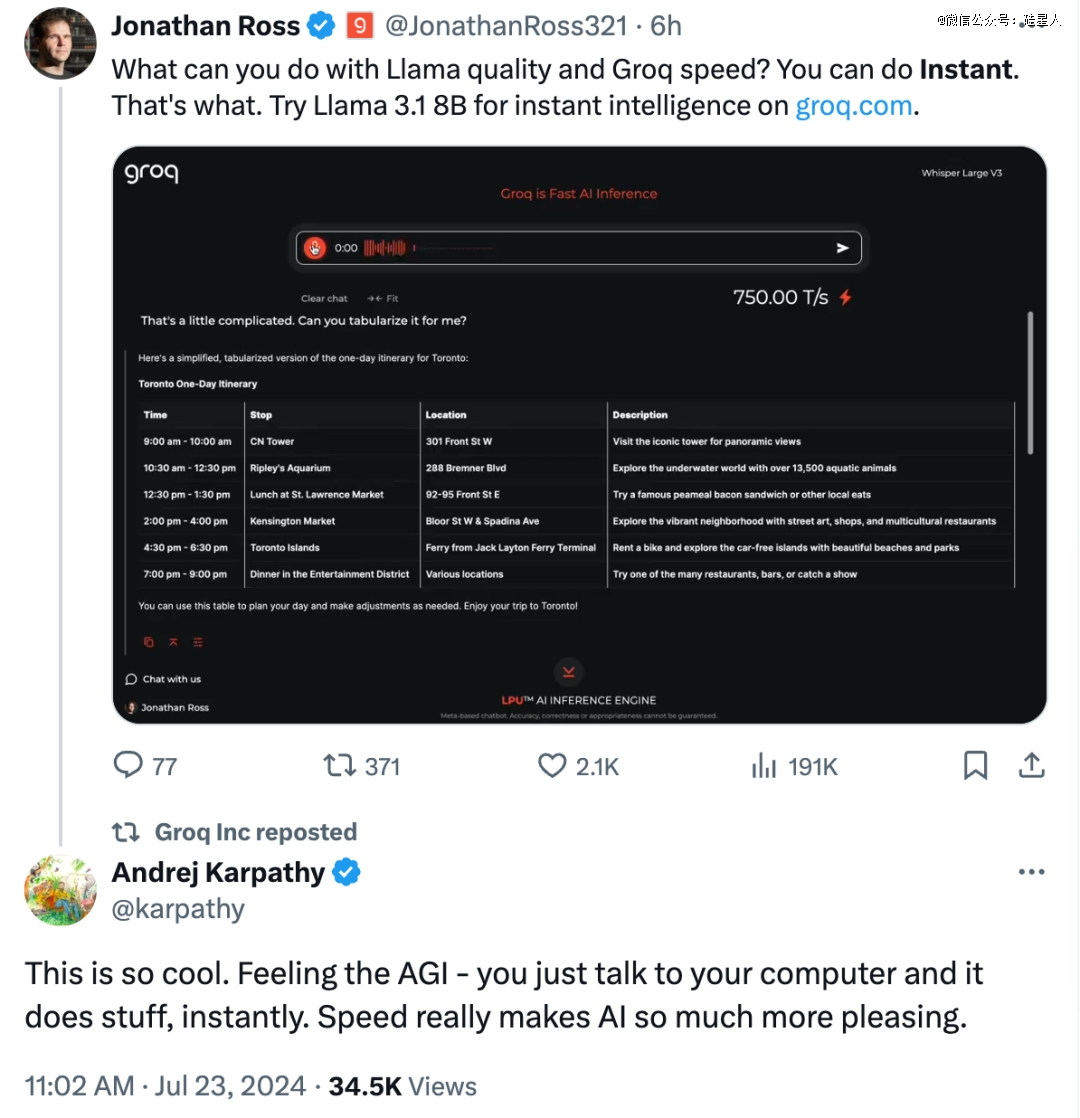

好比AI芯片独角兽Groq,他们开发了一种能快速推理LLM的新型芯片,已经集成了Llama 3.1模子。不仅能以语音对话模式即时推理Llama 3.1 8B,而且其上运行的405B可能是现在性能最强、速率最快的LLM。

而这样的惊艳例子只会越来越多,使得开源阵营的体量和竞争力与日俱增,最终或许使得闭源优势不再。

不外Karpathy也在推文中玩笑地说,“预计闭源模子的玩家很快就会追赶,我期待着这一点。”

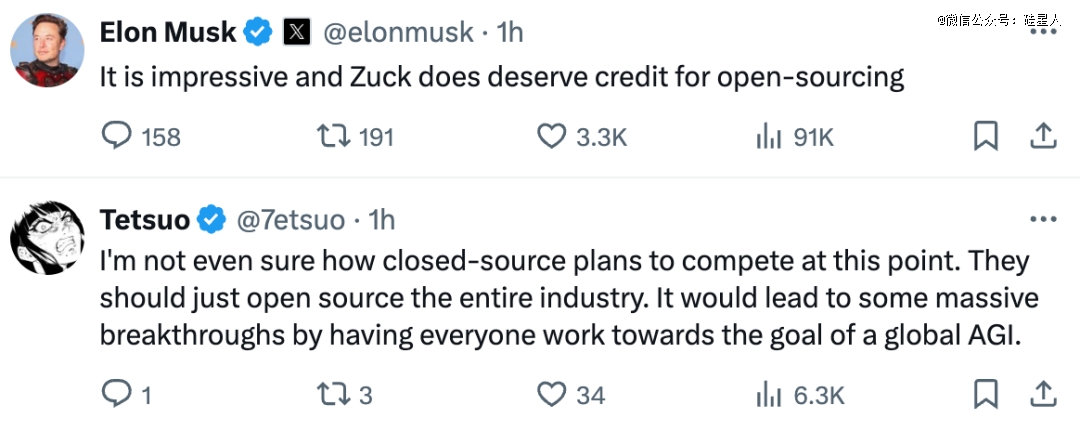

马斯克赞美了扎克伯格为开源社区做出的孝顺。用户@7etsuo说,“我甚至不确定闭源在这一点上设计怎么竞争。他们应该也向整个行业开放。让每小我私人都致力于AGI目的,从而带来一些重大突破。”

在当天早上宣布的一封公然信中,扎克伯格描绘了一个未来的愿景,即AI工具和模子能够到达天下各地更多的开发者手中,确保人们能同等享受到AI的“利益和时机”。

现在,Llama 3.1系列已经与AWS, 英伟达, Databricks, 戴尔, 微软Azure和谷歌云等25家公司成为生态互助同伴。而住手现在,Llama模子已经被下载跨越3亿次,确立了跨越2万个Llama派生模子。

现在Llama 3.1的横空出世,闪开源模子在能力上正式向闭源巨头宣战。我们可以预见到的是,AI手艺和成本的准入门槛将大幅降低,少数公司的垄断事态被打破,全球AI研究与应用历程加速,手艺创新向多样化生长。

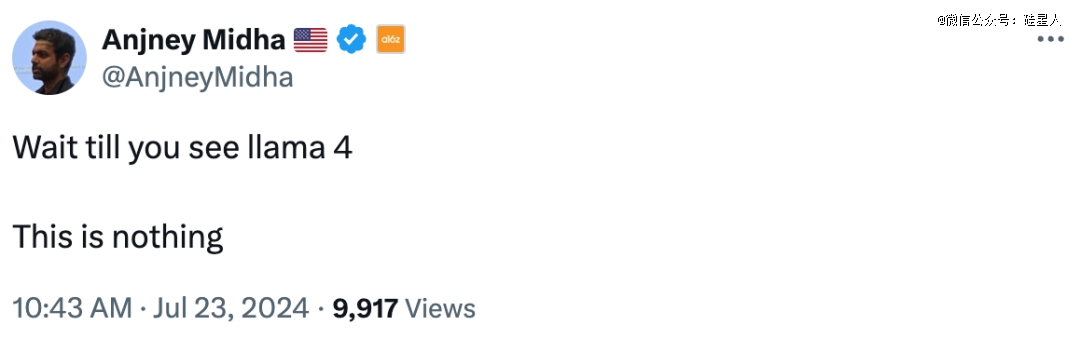

而且据扎克伯格透露,Meta已经在研发更壮大的Llama 4了!

a16z合资人Anjney Midha就放话说,与Llama 4相比,“Llama 3.1 is nothing”。

随着开源模子不停提高,AI手艺民主化或许已是事态所趋。

到底AGI被谁先实现?

现在看来,谜底真纷歧定是OpenAI。